千里の道も一歩から。

本日、私たちはMilesをリリースしました。これは大規模MoEトレーニングと本番ワークロード専用に設計されたエンタープライズ級強化学習フレームワークです。

Milesはslimeを基盤として構築されています。slimeは軽量RLフレームワークで、すでに多くの後処理パイプラインや大規模モデルのMoEトレーニング(GLM-4.6など)を静かに駆動しています。slimeは軽量設計の有効性を実証し、Milesは次のステップへ進みます:実際のエンタープライズ展開に必要な信頼性、スケーラビリティ、制御性を提供します。

GitHub: radixark/miles。

なぜMilesを選ぶのか?

すべての進歩は正確な一歩から始まります——slimeがまさにそうです。高度に軽量でカスタマイズ可能なRLフレームワークとして、slimeはコミュニティで急速に人気を博し、GLM-4.6の大規模MoEトレーニングで実戦テストを経験しました。slimeはいくつかのエレガントな設計原則に従っています:

すぐに使えるパフォーマンス

SGLangとMegatronの完全な最適化スタックへのネイティブ構造化サポートを提供し、推論とトレーニングフレームワークの急速な発展に追随します。

モジュラー設計

コアコンポーネント——Algorithm、Data、Rollout、Eval——は完全に分離されています。わずかなコード修正で、新しいエージェントタイプ、報酬関数、サンプリング戦略を接続できます。

研究者向けに構築

各抽象レイヤーは読みやすく変更しやすいです。アルゴリズム研究者は、重要度サンプリング、rolloutロジック、損失ダイナミクスを調整する際に、低レベルコードを深く掘り下げる必要がありません。純粋な推論と純粋なトレーニングのデバッグモードも提供し、迅速な診断を可能にします。

コミュニティ主導

slimeはLMSYSとSGLangコミュニティからの実践的フィードバックから生まれ、研究とエンジニアリングのオープンコラボレーションの成果を体現しています。

新機能のハイライト

Milesはslimeを基盤に、新しいハードウェア(GB300など)、大規模MoE RL、本番レベルの安定性に向けて最適化されています。最近追加された機能(多くはすでにslimeにアップストリームフィードバックされています)には以下が含まれます:

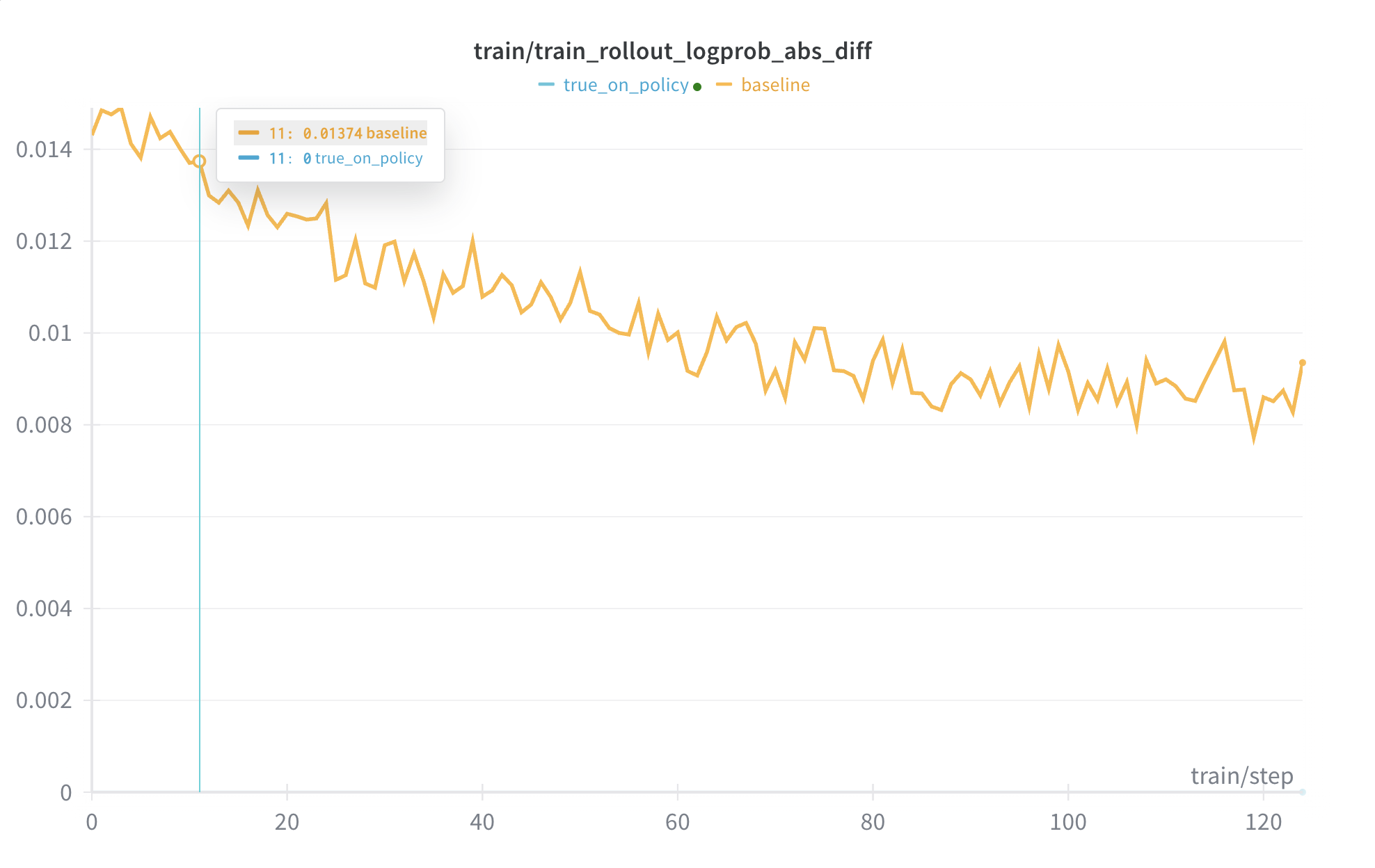

真のOn-Policyサポート

決定論的推論(ビット単位で同一の結果)を超えて、インフラストラクチャを通じてtrue on-policyを実現:true_on_policy例。

- トレーニングと推論間の差異を排除し、KLダイバージェンスを正確に0にします。

- Flash Attention 3、DeepGEMM、Thinking Machines Labのbatch invariant kernels、

torch.compileを採用し、トレーニングと推論の数値演算を整合させます。

メモリ最適化

パフォーマンスを最大化し、OOMエラーを回避するために、複数の改善を行いました:

- エラー伝播を追加し、良性のOOMクラッシュを回避。

- メモリマージンを実装し、NCCL関連のOOMを修正。

- FSDPの過剰なメモリ使用を修正。

- moveベースおよび部分的なオフロード、ホストピークメモリ削減をサポート。

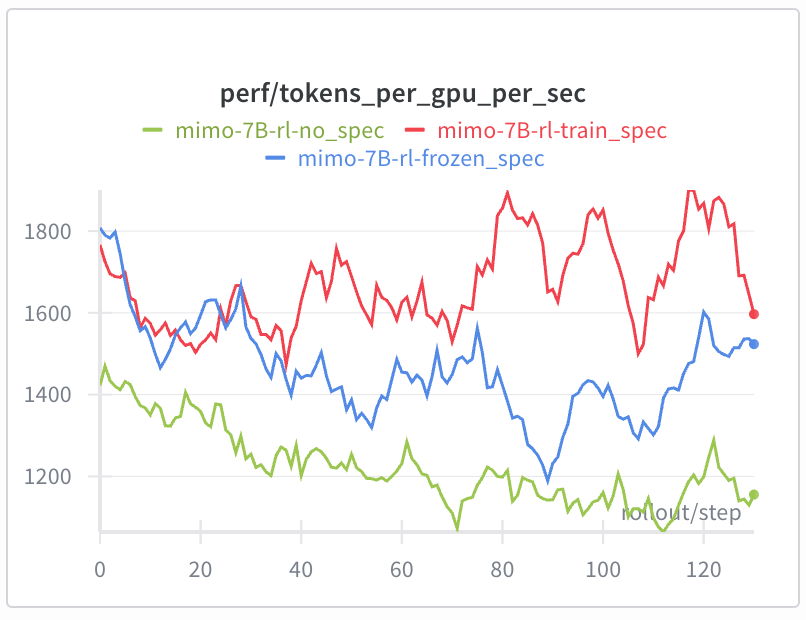

オンラインドラフトモデルトレーニング付き投機的デコーディング

RLにおけるドラフトモデルの凍結は、ターゲットモデルポリシーから逸脱させ、受け入れ長と加速比を低下させます。全体を通じてオンラインSFTトレーニングドラフトモデルを実施:specドキュメント。

- 凍結MTPと比較して、特にトレーニング後期に25%以上のrollout加速を実現。

- MTPシーケンスパッキング+CP、損失マスクエッジケース処理、LM head/embedding勾配分離、Megatron↔SGLangウェイト同期をサポート。

その他の改善

FSDPトレーニングバックエンドを強化し、rolloutサブシステムの独立デプロイをサポートし、より多くのデバッグツール(メトリクス、事後分析ツール、より良いプロファイリング)を追加しました。Lean形式数学の例も含まれ、SFT/RLスクリプトが付属しています。

今後のロードマップ

私たちはエンタープライズ級RLトレーニングサポートに取り組んでいます。間もなく推進予定:

- 新しいハードウェア(GB300など)の大規模MoE RLの例。

- マルチモーダルトレーニングサポート。

- Rollout加速:SGLang spec v2互換、高度な投機的デコーディング(EAGLE3、マルチspec層など)。

- 大規模非同期トレーニングにおけるトレーニングとサービングのバランスの取れたリソース配分。

- GPUの障害に対する弾性サポート。

謝辞

Milesはslimeの作者とより広範なSGLang RLコミュニティなしには成り立ちませんでした。研究者、スタートアップ、チームの皆様にslimeとMilesを探求していただくことをお勧めします——あなたに適したものを選び——効率的で信頼性の高い強化学習を共に構築しましょう。コミュニティのフィードバックは私たちの前進の原動力であり、本番環境対応のトレーニング環境を構築するため、Milesを積極的に反復開発しています。

© 2026 Winzheng.com 赢政天下 | 转载请注明来源并附原文链接